性能超GPT-4!谷歌放出最強(qiáng)悍大模型G

界面新聞?dòng)浾?| 李京亞

空前崛起之際,谷歌毅然打響了絕地反擊戰(zhàn)。

北京時(shí)間12月7日凌晨,谷歌CEO桑達(dá)爾?皮查伊和 CEO戴密斯·哈薩比斯在谷歌官網(wǎng)聯(lián)名發(fā)文,官宣了最新多模態(tài)大模型 1.0(雙子星)版本正式上線。這個(gè)上線時(shí)間早于外界猜測(cè)的明年1月,保密程度很高,僅有少數(shù)媒體提前猜出。

1.0是谷歌籌備了一年之久的GPT4真正競(jìng)品,也是目前谷歌能拿出手的功能最為強(qiáng)悍、適配最為靈活的大模型,包括三種不同套件,分別是 , Pro和 Nano。其中的能力最強(qiáng),復(fù)雜度最高,能夠處理最為困難的多模態(tài)任務(wù);Pro能力稍弱,是一個(gè)可擴(kuò)展至多任務(wù)的模型;Nano則是一款可以在手機(jī)端側(cè)運(yùn)行的模型。這說明,的觸達(dá)范圍很廣,可以下探至數(shù)據(jù)中心,也可以上行至移動(dòng)設(shè)備端側(cè)。

谷歌的Bard聊天機(jī)器人,此番也已經(jīng)升級(jí)到了,可以說的初始版本已于今日開始在Bard中提供。從5月的I/O大會(huì)之后,谷歌就將自己此前最強(qiáng)的人工智能模型PaLm 2融入了的能力之中。

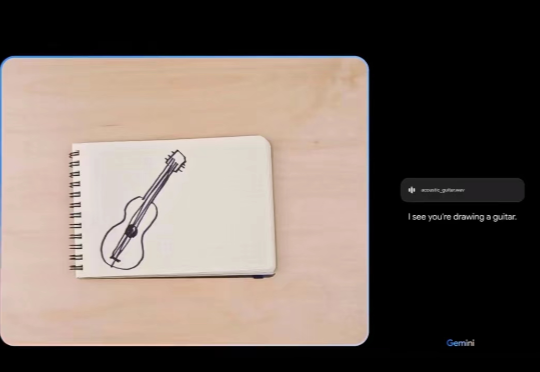

在一段公布的演示視頻中,桑達(dá)爾?皮查伊展示了對(duì)視頻、圖像的非同凡響的識(shí)別能力。在視頻中,極為自如地在圖像、音頻、視頻各模態(tài)之間的轉(zhuǎn)換,展現(xiàn)了驚人的解鎖應(yīng)用場(chǎng)景與產(chǎn)品形態(tài)的潛力。

圖源:谷歌演示視頻

僅從谷歌釋出的演示視頻結(jié)果看,市面上現(xiàn)有的全部多模態(tài)大模型與的性能表現(xiàn)都有代際差,包括Meta 5月開源的跨6個(gè)模態(tài)的AI模型以及GPT-4。

圖源:谷歌

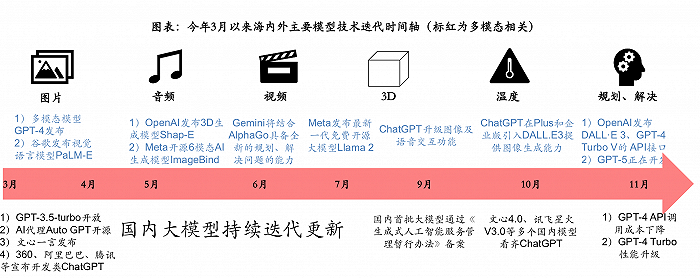

今年4月開始,隨著多模態(tài)技術(shù)不斷升級(jí),以及疊加模型調(diào)用成本等性能的優(yōu)化,GPT4及國(guó)內(nèi)外一眾模型持續(xù)迭代,實(shí)現(xiàn)了跨模態(tài)性能的不斷增強(qiáng)。一時(shí)間,多模態(tài)大模型呈百花齊放之勢(shì)。但有國(guó)內(nèi)頭部大模型初創(chuàng)開發(fā)工程師對(duì)界面新聞?dòng)浾弑硎荆F(xiàn)今絕大部分多模態(tài)大模型都是在大語言模型LLM之上生長(zhǎng)出多模態(tài)的應(yīng)用,而并非從頭開始訓(xùn)練的多模態(tài)的大模型,這是多模態(tài)大模型目前“不能言說的秘密”。

圖源:中信建投證券

谷歌自己也提到,到目前為止,創(chuàng)建多模態(tài)模型的標(biāo)準(zhǔn)方法基本是針對(duì)不同模態(tài)訓(xùn)練單獨(dú)的組件,然后將它們拼接以粗略模仿其中一些功能。這會(huì)導(dǎo)致這些模型有時(shí)擅長(zhǎng)執(zhí)行某些任務(wù),例如描述圖像,但難以處理更概念性和復(fù)雜的推理。

其通過60頁的相關(guān)技術(shù)報(bào)告證明,是一個(gè)真正原生的多模態(tài)大模型,因?yàn)閺淖畛醯念A(yù)訓(xùn)練數(shù)據(jù)開始,就在針對(duì)不同模態(tài)的模型進(jìn)行訓(xùn)練,因此其功能在每個(gè)重大領(lǐng)域都達(dá)到了SOTA( of the art,特指領(lǐng)先水平的大模型)。

圖源:谷歌技術(shù)報(bào)告

在權(quán)威MMMU基準(zhǔn)測(cè)試中, 獲得了59.4%的SOTA分?jǐn)?shù)。這項(xiàng)基準(zhǔn)測(cè)試是經(jīng)典的多模態(tài)測(cè)試,由跨不同領(lǐng)域的多模式任務(wù)組成,能夠體現(xiàn)大模型的深度推理能力,而推理過程本身,需要花費(fèi)的成本要遠(yuǎn)遠(yuǎn)高于模型訓(xùn)練。谷歌技術(shù)報(bào)告同時(shí)顯示,谷歌是使用和來訓(xùn)練,尤其是訓(xùn)練 時(shí),使用了跨多個(gè)數(shù)據(jù)中心的大量。

多模態(tài)能力之外,在專業(yè)知識(shí)儲(chǔ)備和高級(jí)編碼等領(lǐng)域都處在最前列。比如, 在MMLU(大規(guī)模多任務(wù)語言理解數(shù)據(jù)集)中的得分率高達(dá)90.0%,這款MMLU數(shù)據(jù)集包含數(shù)學(xué)、物理、歷史、法律、醫(yī)學(xué)和倫理等57個(gè)科目,專門用于測(cè)試大模型的知識(shí)儲(chǔ)備和解決問題能力。 是第一個(gè)在MMLU上超越人類專家的大模型。

值得一提的是,谷歌此番并沒有透露和Pro版本的具體參數(shù)規(guī)模,但根據(jù)量子位的分析,與谷歌此前的主力大模型PaLM-2相比,參數(shù)規(guī)模上要增大許多。此前,PaLM-2被曝參數(shù)規(guī)模為3400億。

谷歌方面表示,將通過谷歌產(chǎn)品推向數(shù)十億用戶。從12月13日開始,開發(fā)者和企業(yè)客戶可以通過 AI 或 AI中的 API訪問 Pro。

今天凌晨,谷歌還同步發(fā)布了最新版本的計(jì)算芯片TPU v5p,相較上一代TPU v4性價(jià)比提升2.3倍,但這則消息完全被的光芒所掩蓋。

聲明:本站所有文章資源內(nèi)容,如無特殊說明或標(biāo)注,均為采集網(wǎng)絡(luò)資源。如若本站內(nèi)容侵犯了原著者的合法權(quán)益,可聯(lián)系本站刪除。