ChatGPT為泄密致歉 誰(shuí)來(lái)保護(hù)我們的

自爆火全球,贊譽(yù)隨之涌來(lái),爭(zhēng)議也甚囂塵上。人們擔(dān)心的事還是發(fā)生了:用戶隱私遭到泄露,也讓陷入風(fēng)波。

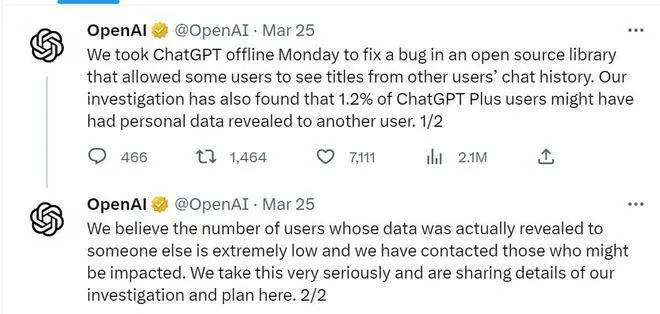

網(wǎng)友聲稱,其聊天欄出現(xiàn)了他人的聊天記錄標(biāo)題。3月25日,發(fā)文證實(shí),部分 Plus服務(wù)訂閱用戶可能泄露了部分個(gè)人隱私和支付信息。

“我們?cè)诒敬侮P(guān)閉幾個(gè)小時(shí)前,部分用戶可能會(huì)看到另一位用戶的姓名、電子郵件地址、支付地址、信用卡信息。我們承諾在任何情況下,都不會(huì)暴露完整的信用卡號(hào)碼。”向用戶和整個(gè)社區(qū)致歉。

圖源:社交平臺(tái)截圖

一紙道歉信,沒(méi)有平息風(fēng)波。人們反而陷入擔(dān)憂,一向“神通廣大”的,會(huì)輕松竊走我的隱私嗎?令人炫目的AI技術(shù),會(huì)被不法分子利用嗎?

自稱“會(huì)保護(hù)隱私”

實(shí)際真的如此嗎?

到底會(huì)不會(huì)記住用戶的信息?我們先做了一個(gè)測(cè)試。當(dāng)問(wèn)它隱私話題時(shí),的回答相當(dāng)謹(jǐn)慎,不過(guò),它有自相矛盾的地方。

首先,它聲稱不會(huì)記住用戶的任何信息,包括聊天內(nèi)容,但隨即又說(shuō),與用戶對(duì)話的數(shù)據(jù)可能存儲(chǔ)在的數(shù)據(jù)中心或使用的云服務(wù)提供商的數(shù)據(jù)中心。

提問(wèn):你和我之間的對(duì)話,你會(huì)保密嗎?

:作為一個(gè)AI訓(xùn)練模型,我沒(méi)有意識(shí),也不能記憶您的任何信息,也不能主動(dòng)泄露您的任何信息。我只能回答您的問(wèn)題,并遵循的隱私政策。您可以放心與我對(duì)話。

提問(wèn):你和我聊天的數(shù)據(jù),你存儲(chǔ)在哪里?

:存儲(chǔ)訓(xùn)練和運(yùn)行模型所需的數(shù)據(jù),并嚴(yán)格遵守隱私和安全政策。具體來(lái)說(shuō),您與我對(duì)話的數(shù)據(jù)可能存儲(chǔ)在的數(shù)據(jù)中心或使用的云服務(wù)提供商的數(shù)據(jù)中心中,以便實(shí)現(xiàn)最佳的性能和可用性。任何存儲(chǔ)的數(shù)據(jù)都受到嚴(yán)格的訪問(wèn)控制和保護(hù)措施的保護(hù),以確保您的數(shù)據(jù)安全。

宣稱“不會(huì)記住用戶信息”,從這次隱私事件來(lái)看,顯然是不成立了。那么,在和人們的對(duì)話中,會(huì)不會(huì)一不小心說(shuō)漏嘴,泄露他人信息嗎?

浙江大學(xué)計(jì)算機(jī)學(xué)院教授湯斯亮告訴潮新聞?dòng)浾撸瑥拇笮驼Z(yǔ)言模型的訓(xùn)練方式來(lái)看,的確存在隱私漏洞。比如,讓它補(bǔ)寫(xiě)代碼,它會(huì)東邊摘一點(diǎn),西邊摘一點(diǎn),合成一段代碼。但有人發(fā)現(xiàn),它補(bǔ)出來(lái)的代碼跟網(wǎng)上代碼是一樣的。它其實(shí)是在抄那些代碼。

如果再延伸一下,比如讓它補(bǔ)李彥宏的身份證,的確能補(bǔ)出一串?dāng)?shù)字,也是18位格式,但并不是真實(shí)的李彥宏身份證,只是它知道身份證有18位。有人擔(dān)心,如果它能獲取真實(shí)的身份證,那隱私可能會(huì)被泄露。

但是,湯斯亮也指出,雖然收集了個(gè)人數(shù)據(jù),但這些數(shù)據(jù)未必會(huì)用來(lái)訓(xùn)練,因?yàn)樗鼘W(xué)習(xí)語(yǔ)料的代價(jià)很高,每訓(xùn)練一次就需要大量資金投入。雖然你把身份證告訴它,它可能只是存儲(chǔ)了,也可能不存儲(chǔ)。

“就算真的記住了身份證號(hào),如果不加以刻意地引導(dǎo)、提示,它并不會(huì)用來(lái)生成回答。這段信息存在它龐大的45TB語(yǔ)料之中,日后生成出來(lái)的概率是極其微小的。”湯斯亮說(shuō)。

圖源:新華社

泄密、攻擊、虛假信息

語(yǔ)言模型里的隱私誰(shuí)來(lái)保護(hù)?

已推出了GPT4,谷歌Bard、百度文心一言也緊隨其后,大型語(yǔ)言模型越來(lái)越多,功能越來(lái)越強(qiáng)大,但是我們的隱私地盤,是不是越來(lái)越少了?

浙江大學(xué)計(jì)算機(jī)科學(xué)與技術(shù)學(xué)院教授陳華鈞曾在接受潮新聞?dòng)浾卟稍L時(shí)表示,數(shù)據(jù)安全、隱私保護(hù)都屬于安全AI或盡責(zé)人工智能的問(wèn)題,現(xiàn)有的人工智能大模型大多存在這個(gè)問(wèn)題。

“如果你的個(gè)人信息被學(xué)習(xí)進(jìn)它的大腦中,隱私追溯比起以前的互聯(lián)網(wǎng)更加困難。至于它產(chǎn)生數(shù)據(jù)屬于誰(shuí),如何保存和監(jiān)管,目前在法律上還存在空白。” 陳華鈞說(shuō)。

上周,出現(xiàn)技術(shù)漏洞,用戶看到他人的搜索記錄,首席執(zhí)行官Sam 發(fā)推文回應(yīng),修復(fù)程序已驗(yàn)證完成,并對(duì)此“感覺(jué)十分糟糕”。

最近,Sam 在接受媒體采訪時(shí)也坦白,對(duì)AI技術(shù)以及它如何影響勞動(dòng)力、選舉和虛假信息的傳播有些害怕,“我擔(dān)心這些模型可能會(huì)被用于大規(guī)模的虛假信息傳播。”

雖然語(yǔ)言對(duì)話模型在科技界受到熱捧,但不少科技巨頭卻心存警惕,甚至警告員工不要與其分享機(jī)密信息。

日前,據(jù)央廣網(wǎng)報(bào)道,微軟的工程師和亞馬遜的律師都曾警告員工,不要與分享“任何亞馬遜的機(jī)密信息,包括你正在編寫(xiě)的代碼,因?yàn)樗麄兛赡軙?huì)將其用于訓(xùn)練未來(lái)的模型。”

這些“無(wú)所不能”的類語(yǔ)言模型,也隱含著不少法律風(fēng)險(xiǎn)。

“對(duì)信息、數(shù)據(jù)來(lái)源無(wú)法進(jìn)行事實(shí)核查,可能存在個(gè)人數(shù)據(jù)與商業(yè)秘密泄露和提供虛假信息兩大隱患。”北京盈科(上海)律師事務(wù)所互聯(lián)網(wǎng)法律事務(wù)部主任謝連杰在接受媒體采訪時(shí)說(shuō)。

謝連杰分析,依托海量數(shù)據(jù)庫(kù)信息存在,其中包括大量的互聯(lián)網(wǎng)用戶自行輸入的信息,因此當(dāng)用戶輸入個(gè)人數(shù)據(jù)或商業(yè)秘密等信息時(shí),可能將其納入自身的語(yǔ)料庫(kù)而產(chǎn)生泄露的風(fēng)險(xiǎn)。雖然承諾刪除所有個(gè)人身份信息,但未說(shuō)明刪除方式,在其不能對(duì)信息與數(shù)據(jù)來(lái)源進(jìn)行事實(shí)核查的情況下,這類信息仍然具有泄露風(fēng)險(xiǎn)。

Sam 警告說(shuō),人工智能的廣泛使用可能會(huì)帶來(lái)負(fù)面影響,這需要政府和社會(huì)共同參與監(jiān)管。他呼吁反饋和規(guī)則對(duì)抑制人工智能的負(fù)面影響非常關(guān)鍵。

聲明:本站所有文章資源內(nèi)容,如無(wú)特殊說(shuō)明或標(biāo)注,均為采集網(wǎng)絡(luò)資源。如若本站內(nèi)容侵犯了原著者的合法權(quán)益,可聯(lián)系本站刪除。